Die Meldungen über die Google Search Console scheinen nicht abzureißen. Auch in dieser Woche hat es zwei neue Änderungen gegeben. In dem Top-Thema dieser Woche haben wir uns einige Methoden der Indexentfernung angeschaut. Wir wünschen Euch viel Spaß beim Lesen!

Indexbereinigung (Teil 1) – So entfernt Ihr Seiten aus dem Index

In dem Top-Thema der KW49 berichteten wir bereits darüber, wie Ihr einen überfüllten Index identifizieren könnt. Heute wollen wir uns dem Folgethema, der Deindexierung von Seiten, widmen. Im Fokus stehen dabei Methoden, die die Suchmaschine Google betreffen.

Grundlagen zur Vermeidung von Deindexierungen

Es gibt viele Wege, wie Seiten aus dem Index entfernt werden können. Je nach Methode kann dies ein langwieriger Prozess sein.

Generell empfehlen wir Euch, immer mit einer klaren Website-Architektur zu arbeiten, die eine nachhaltige Langzeit-SEO-Strategie beinhaltet. Ist diese vorhanden, ist es auch wahrscheinlicher, dass weniger Korrekturen in Form von Deindexierungen umgesetzt werden müssen. Nichtsdestotrotz kann es aber natürlich dennoch dazu kommen, dass Seiten aus dem Index entfernt werden sollen, weil sich beispielsweise Eure Strategie ändert, Ihr aus diesem Grund Eure Website-Architektur umstrukturieren möchtet und folglich auch der Index dem Status quo Eurer Änderungen entsprechen soll.

Für unterschiedliche Szenarien gibt es unterschiedliche Herangehensweisen. Wir stellen Euch nun im Folgenden drei Methoden vor.

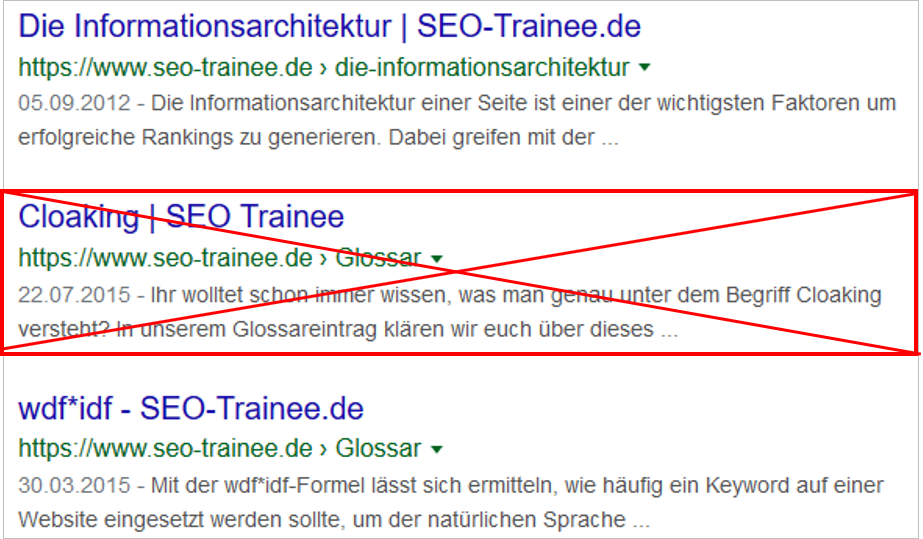

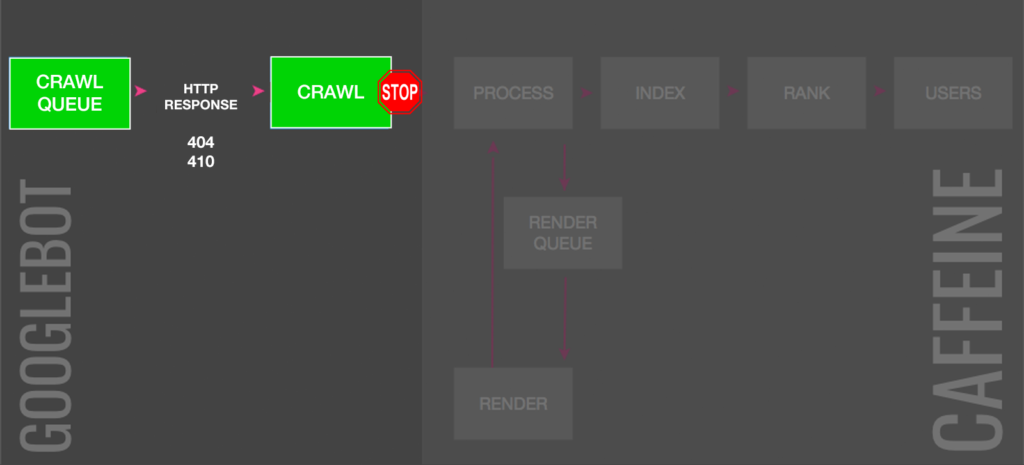

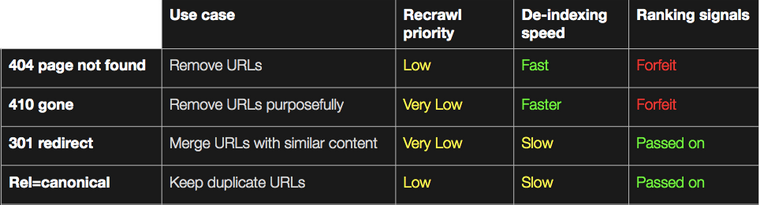

410-Statuscodes

Dieser Statuscode hat bei Suchmaschinen die Bedeutung „Gone“. Anders als bei dem Statuscode 404 wirkt es auf Google entschiedener, dass mit Bestimmtheit eine URL entfernt wurde. Ein 404-Statuscode hat den gleichen Effekt, nur dauert der Deindexierungsprozess laut Search Engine Journal ein wenig länger. Ihr müsst Euch wirklich sicher sein, dass die Seite für immer entfernt werden soll. Die Ranking-Signale, die die jeweilige URL vorweist, werden nach dieser Maßnahme wegfallen.

Zudem sollte immer darauf geachtet werden, dass die internen Verlinkungen der gesamten Domain in die Änderungen miteinbezogen werden. Es sollte keine Seite mehr auf die entfernte Seite verlinken, da dies für ein schlechtes Nutzererlebnis sorgt.

Darüber hinaus empfehlen wir, diese Variante nicht bei einer großen Anzahl von URLs, die entfernt werden sollen, anzuwenden. Ist die Anzahl von URLs, die einen 4XX-Statuscode an den Crawler wiedergeben, zu groß (genaue Anzahl nicht bekannt) kann es passieren, dass der Crawling-Prozess komplett eingestellt wird und somit eventuell wichtige URLs nicht gecrawlt werden. Wollt Ihr eine größere Anzahl von URLs deindexieren, empfehlen wir eine der nachfolgenden Varianten.

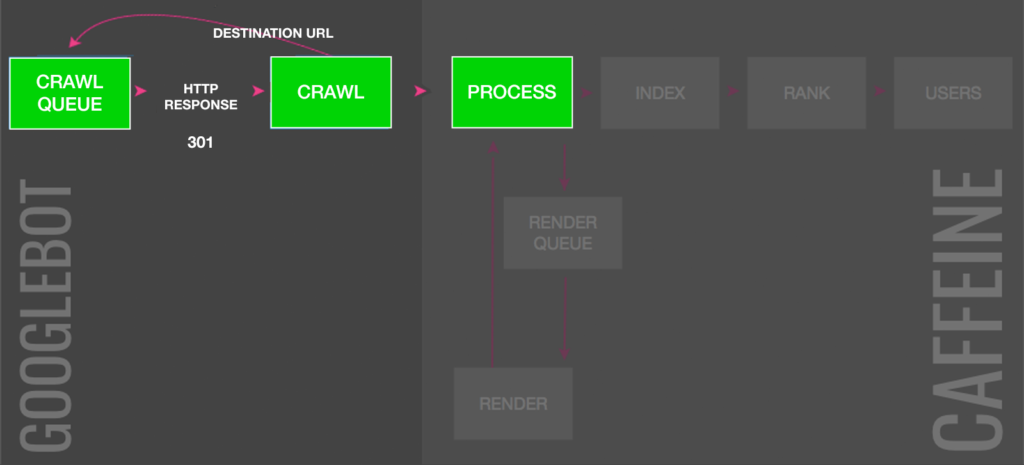

301-Weiterleitungen

Diese Variante können wir Euch empfehlen, wenn mehrere unterschiedliche Seiten Eurer Domain ähnliche Themen behandeln und Ihr Euch deswegen dazu entschließt, diese Inhalte auf einer Seite abzubilden. Auf diese Weise wird nahezu der gesamte Link Juice einer Seite an die weitergeleitete Ziel-URL übergeben. 301-Weiterleitungen sollten auch zum Einsatz kommen, wenn sich beispielsweise die komplette URL-Architektur durch einen Relaunch ändert.

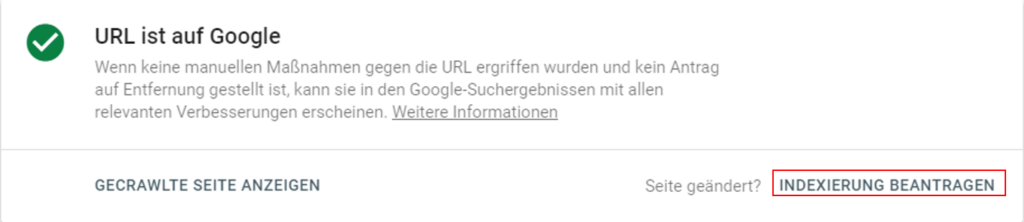

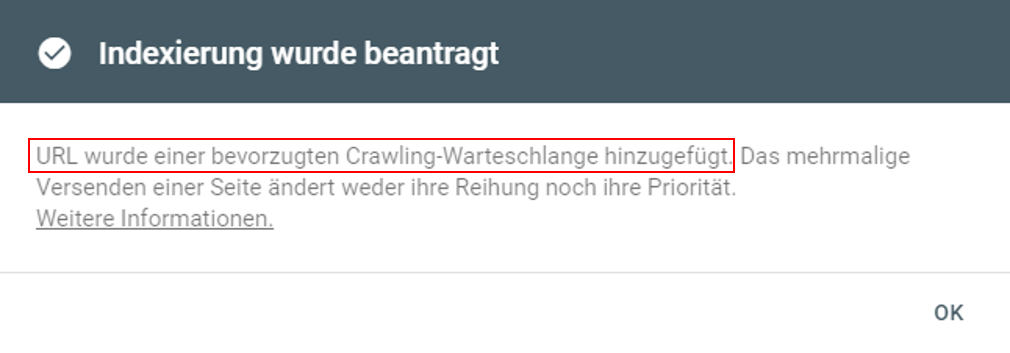

Hier gilt auch, dass die internen Links, die auf die entfernte URL verweisen, auf das neue Link-Ziel angepasst werden müssen. Nutzer, die auf eine solche interne Verlinkung klicken, werden zwar auf das neu festgelegte Ziel weitergeleitet und bemerken dies nicht – Suchmaschinen nehmen diese Weiterleitung allerdings wahr. Bei diesem Prozess wird jedes Mal ein wenig Link Power abgegeben und darüber hinaus wird das Crawling-Budget unnötig belastet, da diese URLs ja nicht mehr suchrelevant sind. Alles in allem kann diese Variante für eine Deindexierung recht lange andauern. Das gilt erst recht, wenn mehrere Weiterleitungen (sogenannte Weiterleitungsketten) eingerichtet sind. Damit Google URLs, die nun auf ein neues Link-Ziel weiterleiten, aus dem Index entfernt, müssen nämlich die Weiterleitungen selbst mit dem 301-Statuscode erst einmal gecrawlt werden. Nun kann es sein, dass aber die jeweilige URL keine hohe Crawling-Priorität in der Crawling-Warteliste hat. Es gibt in der Google Search Console mit dem URL Inspection Tool hier noch die Möglichkeit, händisch nachzuhelfen, indem Ihr eine Indexierung beantragt.

Solltet Ihr generell aber eine schnelle Deindexierung bevorzugen, empfehlen wir Euch, andere Varianten in Betracht zu ziehen.

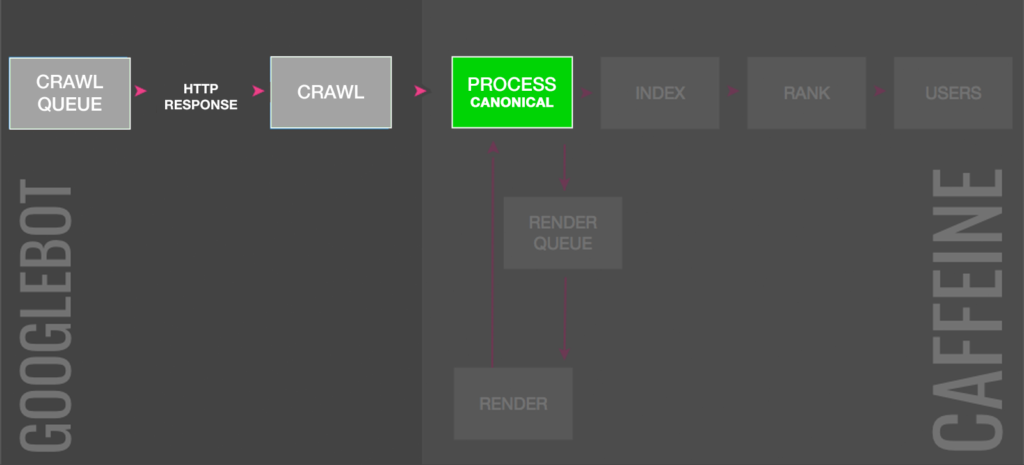

Canonical Tag

Das Canonical Tag solltet Ihr im Head-Bereich einer Seite einsetzen, wenn Ihr Duplicate Content in Eurem Index identifizieren könnt. Diese doppelten Inhalte haben keinen Mehrwert für Nutzer und werden deshalb von Google in Bezug auf Ranking-Signale negativ gewertet.

Mit dem Canonical Tag verweist Ihr auf eine festgelegte Originalressource. Wie schon bei Weiterleitungen wird auch bei Canonical Tags nahezu der gesamte Link Juice an die kanonisch festgelegte URL übertragen. Voraussetzung dafür ist allerdings, dass Google das Canonical Tag auch akzeptiert. Unterscheiden sich die Seiten beispielsweise zu deutlich voneinander, wird das Canonical Tag nicht von Google angenommen und es findet folglich keine Deindexierung statt. Ob Google eine von Euch festgelegte kanonische URL akzeptiert, könnt Ihr testen. Beispielsweise habt Ihr folgende zwei URLs:

- https://www.gmynastikball.de/gruene-gymnastikbaelle/

- https://www.gmynastikball.de/gruene-gymnastikbaelle

Ihr habt nun erstere URL als kanonisch bestimmt. Um zu überprüfen, ob die Auszeichnung von Google akzeptiert wurde, lohnt sich der Einsatz von Suchoperatoren. In diesem Fall kann mit der Abfrage site:www.gmynastikball inurl:“gymnastikbaelle“ überprüft werden, welche Seiten mit dem URL-Fragment „gymnastikbaelle“ sich noch im Index befinden. Sollte sich herausstellen, dass Google das gesetzte Canonical Tag nicht akzeptiert, weil die Inhalte zu unterschiedlich sind, könnt Ihr stattdessen mit einer Weiterleitung arbeiten.

Fazit

Wie bereits erwähnt gibt es verschiedene Methoden der Deindexierung für unterschiedliche Umstände. Wer sich nun vielleicht wundert, dass die ein oder andere Methode noch fehlen könnte, hat natürlich Recht. In einem weiteren Wochenrückblick werden wir für Euch das Thema Indexbereinigung abschließen und weitere Erklärungen zu Deindexierungsvarianten liefern. Zu den heute vorgestellten Methoden hat Search Engine Journal eine Grafik veröffentlicht, die wir als hilfreich ansehen und empfehlen können.

Google News

- Google Discover Performance – Datenlücke und neue Tagesdaten: Das SEO-Portal Search Engine Roundtable berichtete am 16. Dezember darüber, dass es zwischen dem 8. und 13. Dezember zu einer Datenlücke in der Google Search Console bei den Google-Discover-Reporting-Berichten gekommen sei. Die Gründe für diese Lücke sind nicht bekannt. Solltet Ihr einen Rückgang von Traffic in dieser Zeitspanne wahrgenommen haben, läge dies vermutlich an dem Bug, so Google. Darüber hinaus gibt es eine weitere Meldung zu Performance-Daten von Google Discover. Wie auch die Performance-Daten zum Search-Bereich sind nun auch die Leistungsdaten zum Discover-Bereich nach einem Tag einsehbar.

? One last Google Search Console announcement this year! ? Your Discover data on the Performance reports is now *fresher* – similar to what we announced in September for your Search data. Read more at https://t.co/pjaMtJ0d5C

— Google Webmasters (@googlewmc) December 17, 2019

- John Mueller: XML Sitemap wirkt bei dem Google Bot wie ein Energy Drink: Search Engine Journal fasst einen Reddit-Kommentar von John Mueller in einem interessanten Artikel zusammen. Ein Nutzer fragte, ob es überflüssig sei, wenn mehrere Sitemaps für eine Website hinterlegt würden. Mueller antwortete, dass dies nicht notwendig sei, da so oder so alle Sitemap-Dateien als eine importiert werden. Der Google Bot erhält im Anschluss also lediglich eine Liste von URLs. Der Import- und Ausleseprozess sind also getrennt voneinander zu betrachten, da Google Bot nicht weiß, wie viele Sitemaps angelegt werden.

- Separate Robots.txt für Subdomains: Deepcrawl hat in seinem Blog das Webmaster Hangout von John Mueller am 13. Dezember zusammengefasst. Unter anderem hat John Mueller ein Statement zu einer Erstellung von Robots.txt-Dateien für Subdomains gegeben. Eine Robots.txt sollte nicht nur für die Haupt-Domain erstellt werden, sondern auch für eine dazugehörige Subdomain.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen- Update bei den Daten zur Indexabdeckung in der Google Search Console: Am 15. Dezember gab Google eine Erklärung über den eigenen Blog ab, dass die Daten des Indexabdeckungs-Reports der Google Search Console überarbeitet wurden. In dem Blog heißt es wörtlich:

„The Index Coverage report can now more accurately report on indexed pages. Because of this, some pages that were Crawled – currently not indexed are now known to be indexed. As a result, you may see a transfer of pages from Excluded to Valid state. This does not reflect any changes in your site, but a more accurate accounting system.“

From Dec 15, the Index Coverage report can more accurately report on indexed pages. Because of this, some pages that were „Crawled – currently not indexed“ are now known to be indexed. You’ll see a chart notification in this report. pic.twitter.com/RLgmo6x8jX

— Google Webmasters (@googlewmc) December 18, 2019

- Probleme mit Noindex-Auszeichnungen für Google-News: SEO-Südwest berichtete am 18. Dezember, dass wohl News-Inhalte einiger Publisher trotz einer Auszeichnung mit dem Noindex Meta Tag in den Nachrichten bei Google aufgenommen wurden. SEO-Suedwest bezieht sich dabei auf einen Twitter Post des Kolumnisten Glenn Gabe, der für das SEO-Nachrichtenportal Search Engine Land berichtet. Gabe erklärte, dass diese Vorkommnisse vermehrt mit der Einführung des neuen Publisher Centers von Google beobachtet wurden (wir berichten in KW50). Ob es einen Zusammenhang gibt, ist noch nicht bekannt.

Vermischtes

- Neue Bing Crawler auf Basis von Google Chrome: Google hat vor einigen Tagen schon bekannt gegeben, dass ihre Crawler nun auf der aktuellsten Version von Chromium laufen. Nun aktualisiert auch Bing seinen neuen Bingbot auf Basis von Chrome und sorgt dafür, dass auch neue Features auf Websites gerendert werden können. Weitere technische Details könnt Ihr dem Artikel auf SEO-Südwest entnehmen.

- Netflix veröffentlicht Kundenzahlen: Es ist kein Geheimnis, dass Netflix sich steigender Beliebtheit erfreut, allerdings wurden jetzt offiziell erstmals Kundenzahlen des Streamingdienstes veröffentlicht. Die USA und Kanada zählen dabei die meisten User, aber in Europa, dem Nahen Osten und Afrika ist das stärkste Wachstum zu sehen. Die Kollegen von BASIC thinking haben sich die Zahlen etwas genauer angeschaut.

- WebAssembly neuer Web-Standard: Neben HTML, CSS und JavaScript ist nun auch WebAssembly vom World Wide Web Consortium (W3C) zur vierten Code-Sprache erklärt worden. Die Einführung von WebAssembly ermöglicht es nun, komplexere Anwendungen mit dem Einsatz von Open-Web-Platform-Technologien zu nutzen. Auf Heise.de könnt Ihr mehr zu dem Thema erfahren.

Unsere Tipps der Woche

- Star Wars Trailer als Videospiel-Event: Zum Start des neuen Star-Wars-Filmes in den Kinos hat sich das Team von Fortnite eine wirklich beeindruckende Marketing-Idee ausgedacht. Als Teil des Spiels konnten die Spieler aktiv Teil eines speziellen Trailers sein und eine Raumschiff-Schlacht live miterleben. Dazu kamen noch exklusive Interviews. Jack Appleby hat das ganze Event als Video festgehalten, sodass Ihr es nochmal erleben könnt, falls Ihr es verpasst habt.

Star Wars just had 10+ min event in Fortnite that included:

— Jack Appleby (@JuiceboxCA) December 14, 2019

– an exclusive movie trailer

premiered INSIDE the game

– a custom game scene w/

the Millennium Falcon

– a live interview w/ JJ Abrams

– PLAYABLE LIGHTSABERS

Quick thread + analysis: pic.twitter.com/4UIg46aonU

- Neue Episode – Search for Beginners: Als Video-Tipp für das Wochenende haben wir für Euch die neue Episode der Videoserie Search for Beginners von den Google Webmasters. In dieser Folge wird Euch gezeigt, wie Ihr testen könnt, ob Eure Seite indexiert wird und gleichzeitig, was man bei einer Nicht-Indexierung machen kann. Viel Spaß beim Gucken!

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen- Neuer Google Dienst – Shopping 100: Google hat eine neue Anwendung veröffentlicht, mit der Ihr ganz einfach die neuesten Shopping-Trends verfolgen könnt. Shopping 100 zeigt Euch nach Kategorie die aktuellen Top Trending Products an. Mit einem Klick auf ein Produkt landet Ihr auf der passenden Google-Shopping-Seite und könnt Euch dort das passende Angebot aussuchen. Vor allem zur Weihnachtszeit eine tolle Idee, um Inspirationen zu sammeln, falls Ihr noch nicht alle Geschenke zusammen habt.

Ein schönes Wochenende und frohe Weihnachten wünschen Euch

Janek und die Trainees