Diese Woche fand die erste Google Webmaster Conference statt, die sich einzig und allein dem SEO-Kosmos widmete. Zielsetzung des Events war es, mit Webmastern und der SEO-Community in Kontakt zu treten und sich auszutauschen. Wir selbst waren leider nicht dabei. Nichtsdestotrotz haben wir dem Medienecho gelauscht, welches viele spannende Informationen bereithielt. Wir ordnen für Euch ein, was sich am 4. November in der Google-Zentrale in Mountain View, Kalifornien, ereignete.

Google Webmaster Product Summit 2019

Unsere Twitterline hielt speziell Anfang der Woche eine Fülle von interessanten Kommentaren und Fotos von Google-Präsentation-Slides bereit. Wir haben gesammelt und wollen Euch nun die für uns sieben wertvollsten Kommentare/Fotos über die Konferenz vorstellen. Als wesentliche Quelle verwenden wir die Aufzeichnung von Jackie Chu. Ihre Notizen sind von Garry Illyes retweetet worden und können deshalb als gesicherte Informationen angesehen werden.

Excellent notes! For next year we’re planning more of these events, a couple which will be Product Summits

As Jackie recommended, follow @JohnMu , @dannysullivan/ @searchliaison, but most importantly @googlewmc to learn whe{re,n} are they happening! Good chance some near you ?? https://t.co/1PPG4XkURM

— Gary „??/??“ Illyes (@methode) November 5, 2019

1. Strukturierte Daten: Anhand strukturierter Daten könnt Ihr Euer HTML zusätzlich auszeichnen und somit die Wahrscheinlichkeit erhöhen, dass Eure Seiten als Rich-Media-Ergebnisse in den Google-SERPs angezeigt werden. Mit diesen zusätzlichen Auszeichnungen wird es Google erleichtert, die jeweiligen Seiten zu verstehen. Bei der Webmaster Conference wurde noch einmal betont, dass strukturierte Daten nicht dafür gedacht sind, einen Ranking Boost zu erlangen. Vielmehr ist die Funktion der Auszeichnungen so zu verstehen, Inhalte zu Präsentationszwecken für Nutzer in besonderer Art aufzubereiten. Ihr könnt hier alle Möglichkeiten von Rich-Media-Ergebnissen finden, die mittels strukturierter Daten möglich sind.

Structured data is not a ranking boost for your content. But it does help with presentation and sometimes helps you get into special features which could be placed higher on the page. #gwcps

— Jennifer Slegg (@jenstar) November 5, 2019

2.Reputation von URLs: Google bewertet primär den Status Quo einer Seite. Darüber hinaus betrachtet Google aber auch zu jeder Zeit historische Daten. Zu diesen Daten gehören beispielsweise alte Links.

Regarding if Google looks at the history of urls, Google: We try to look at the site/page in its current form. But the reputation of site and pages is based on historical data. E.g. old links, people talking about sites, etc. #gwcps

— Glenn Gabe (@glenngabe) November 4, 2019

3. robots.txt: Mit der robots.txt könnt Ihr als Webmaster Suchmaschinen mitteilen, welche Seiten sie crawlen sollen und welche nicht. Auf der Konferenz wurde bekräftigt, dass vor jedem Crawl, den der Googlebot ausführt, die robots.txt geprüft wird. Ist die robots.txt für längere Zeit (keine konkrete Definierung) nicht erreichbar, kann der Crawl der kompletten Seite abgebrochen werden.

Googlebot an Crawling: robots.txt – Before Google crawls every single url, it checks robots.txt. The fetch can fail. If it sees 200 code, cool. If they see 404, that’s fine too. No restrictions. If it sees 5XX, ok if it’s transient. But if unreachable, that’s very BAD. #gwcps

— Glenn Gabe (@glenngabe) November 4, 2019

Gemäß Google ist jede vierte Seite von diesem Problem betroffen!

Seriously? One out of four times googlebot cannot reach a site’s robots.txt? ? then they won’t crawl the entire site!! #gwcps pic.twitter.com/wC49yC40zI

— Raffaele Asquer (@raffasquer) November 4, 2019

In Nachhinein äußerte sich John Müller zu diesem Thema auf Twitter. Demnach stimmt etwas grundsätzlich nicht mit einer Website, wenn die robots.txt für normale Suchanfragen (keine Site-Abfrage) in den Suchergebnissen ranken würde. Um dies zu verhindern, empfiehlt Mueller das Noindex-Meta-Tag im Head-Bereich einer Seite einzubinden. Somit wird eine Indexierung der Seite verhindert. Achtet jedoch immer darauf, dass Seiten, die Ihr mit einem Noindex-Meta-Tag im Head-Bereich versehen habt, nicht gleichzeitig in der robots.txt vom Crawling ausgeschlossen werden. Sollte dies nämlich der Fall sein, wird der Crawler die Meta-Angaben nicht auslesen können, da die robots.txt immer als erstes ausgelesen wird. Auf die Weise kann es also trotzdem zu einer Indexierung kommen.

Use the x-robots-tag HTTP header to block indexing of the robots.txt or sitemaps files. Also, if your robots.txt or sitemap file is ranking for normal queries (not site:), that’s usually a sign that your site is really bad off and should be improved instead. https://t.co/DpWz6sYanN

— ? John ? (@JohnMu) November 7, 2019

4.Google-Patente: Wir selbst schauen uns des Öfteren einige Google-Patente an (beispielsweise ein Patent zu Nutzerdaten als Ranking-Faktor), um einen Eindruck davon zu erhalten, wie Google künftig seine Algorithmen anpassen könnte. Diese angemeldeten Patente bedeuten nicht, dass Google diese auch wirklich verwendet.

Google fireside chat: Question re: content accuracy. Google: we patent a lot of things. Doesn’t mean we are using them. What we value is in our rater guidelines. Beyond that, it’s tough to talk about the meaning of truth. Trustworthy is key, but hard to determine truth. #gwcps

— Glenn Gabe (@glenngabe) November 5, 2019

5. Emojis in Suchanfragen:Für eine lange Zeit konnte Google die Bedeutung von Emojis in Suchanfragen nicht verstehen. Google erhält täglich über eine Million Suchanfragen, die Emojis enthalten. Aus diesem Grund entschied man sich dafür, Emojis in Search zu integrieren. Zuvor wurden Emojis schlichtweg ignoriert. Wie das Interpretieren von Emojis genau funktioniert, wurde nicht erklärt.

Google sees over one million searches on emojis per day ?? and it took Google a year to add the ability to search for emojis in search. #gwcps

— Barry Schwartz (@rustybrick) November 4, 2019

6. Rendering von JavaScript: Seitdem eine Evergreen Rendering Engine bei Google eingeführt wurde, kann die Suchmaschine immer besser JavaScript-Inhalte verstehen und schließlich indexieren. Auf der Konferenz gab es nun noch einmal konkrete Informationen zu dem Rendering-Prozess. Benötigt der Googlebot zu viel Rechenzeit, um JavaScript-Inhalte im Rendering-Prozess auszuführen, wird dieser Prozess abgebrochen. Es wurde jedoch über keine detaillierten zeitlichen Limits aufgeklärt, die zu einem solchen Abbruch führen würden.

If you have a page that runs lots and lots of #JavaScript, it may eventually be unrenderable. A Google said: „We’ve seen egregiously broken JavaScript on major sites.“ #gwcps pic.twitter.com/EXh5HAPOW5

— Sarah Teach (@SarahTheTeach) November 4, 2019

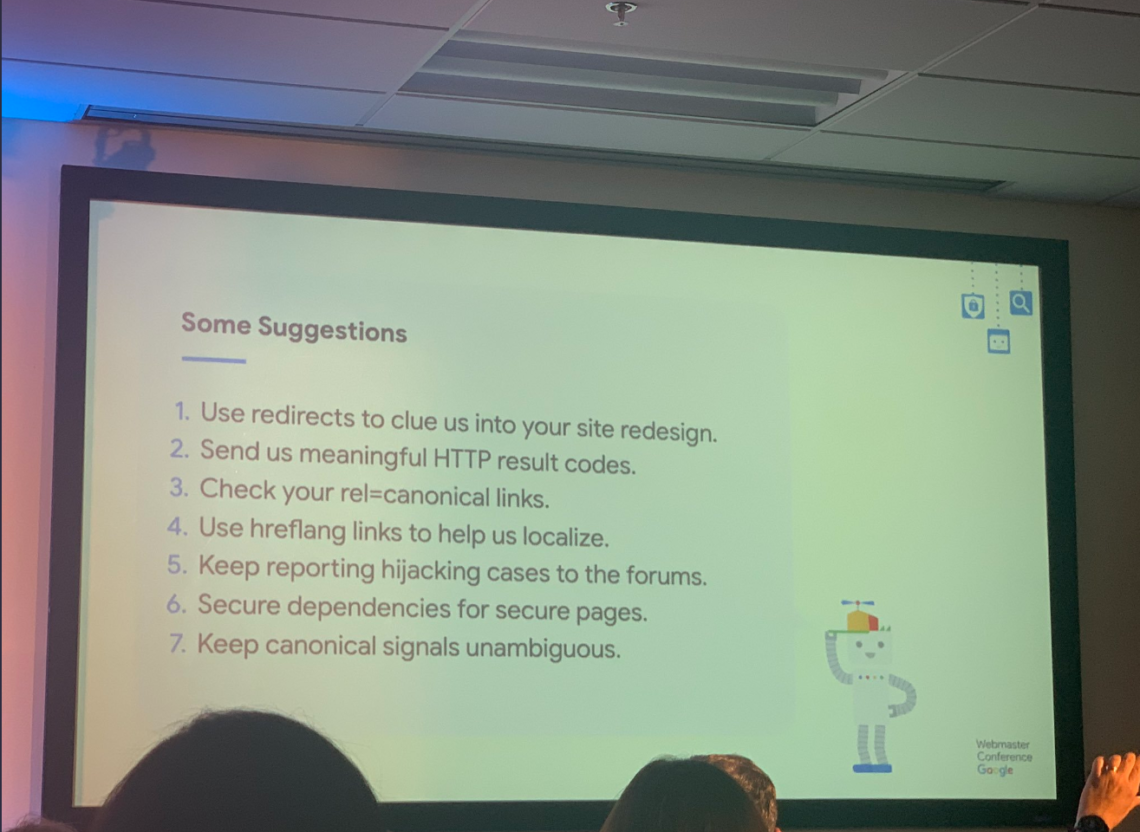

7. Duplicate Content: Doppelte Inhalte mag Google nicht. Weil die Suchmaschine sehr auf die Qualität von Suchergebnissen für die Nutzer bedacht ist, identifiziert Google doppelte Inhalte und schließt diese nach einem Auswahlprozess aus, indem eine kanonische Version festgelegt wird. Dieser Auswahlprozess wurde auf der Konferenz „Web Deduplication“ genannt. Nachfolgend könnt Ihr sieben Vorschläge von Google finden, worauf Ihr bei der Verhinderung von Duplicate Content achten solltet. (siehe Grafik)

Mehrere Google-Webmaster-Konferenzen im kommenden Jahr geplant

Google gibt sich volksnah. Wir finden, Google kann gerne so weitermachen. Der eingangs eingebundene Tweet von Gary Illyes (siehe oben) verspricht, dass auch im nächsten Jahr mit mehreren Konferenzen dieser Art zu rechnen ist. Fantastisch wäre natürlich, wenn auch eine Konferenz in Deutschland abgehalten würde.

Lest gerne die vollständige Aufzeichnung von Jackie Chu, um Euch einen umfassenderen Eindruck der Google Webmaster Product Summit 2019 machen zu können.

Google News

- Google launcht WordPress-Plugin: Mit „Site Kit“ könnt Ihr als Webmaster Google Services in Euer WordPress-Dashboard integrieren. Es handelt sich dabei um Folgende: Search Console, Analytics, PageSpeed Insights, AdSense, Tag Manager und Optimize. WordPress hebt sich in diesem Punkt gegenüber anderen Content-Management-Systemen ab. Ihr erhaltet „Site Kit“ kostenfrei.

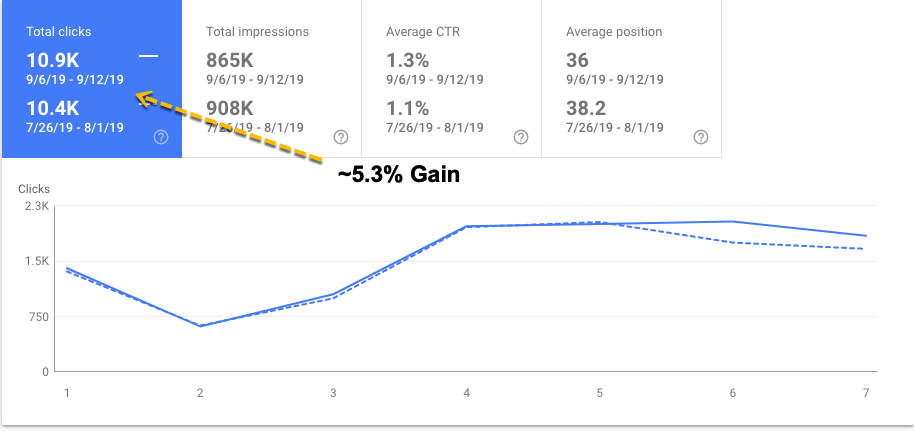

- Das passiert, wenn Ihr Eure Website aus Versehen deindexiert: Jeff Baker hat einen Artikel zu diesem Thema auf Moz veröffentlicht. Der Artikel stellt die Ergebnisse eines Tests dar. Hierbei wurde eine klickstarke Website auf noindex gesetzt und nach kurzer Zeit wieder indexiert. Der Artikel enthält eine Dokumentation von Leistungsdaten sechs Wochen nach der erneuten Indexierung. Nach sechs Wochen ist die Seite nach wie vor von der Deindexierung beeinträchtigt. Die organischen Klicks haben sich im Vergleich beispielsweise nicht vollständig erholen können. Schaut Euch gerne die ganze Dokumentation an, um die vollständigen Ergebnisse zu erfahren.

Sechs Wochen nach der erneuten Indexierung verzeichnet die Seite nach wie vor 5,3 % weniger organische Klicks. ©Jeff Baker - John Müller und Martin Splitt beantworten Nutzerfragen zu Ladegeschwindigkeit: Geballte Expertise in einem Video – wenn Martin Splitt und John Müller reden, hören in der Regel alle zu. Dies könnt Ihr auch bei dem gemeinsamen Video der Google-Mitarbeiter tun, in welchem unter anderem Fragen über Tools, Metriken oder auch zur idealen Ladegeschwindigkeit beantwortet werden.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Vermischtes

- Neues Logo für Facebook: Das neue Logo wird allerdings nicht für die App von Facebook verwendet, sondern für das gleichnamige Unternehmen, welches hinter den Plattformen wie Instagram, WhatsApp, Facebook etc. steht. In der animierten Version des Logos werden die verschiedenen Farben der Marken dargestellt. Mit dem neuen Logo möchte Facebook sich als Marke für das Unternehmen etablieren, welches hinter den verschiedenen Produkten steckt. Mehr zu Facebooks neuem Logo könnt Ihr auf allfacebook.de nachlesen.

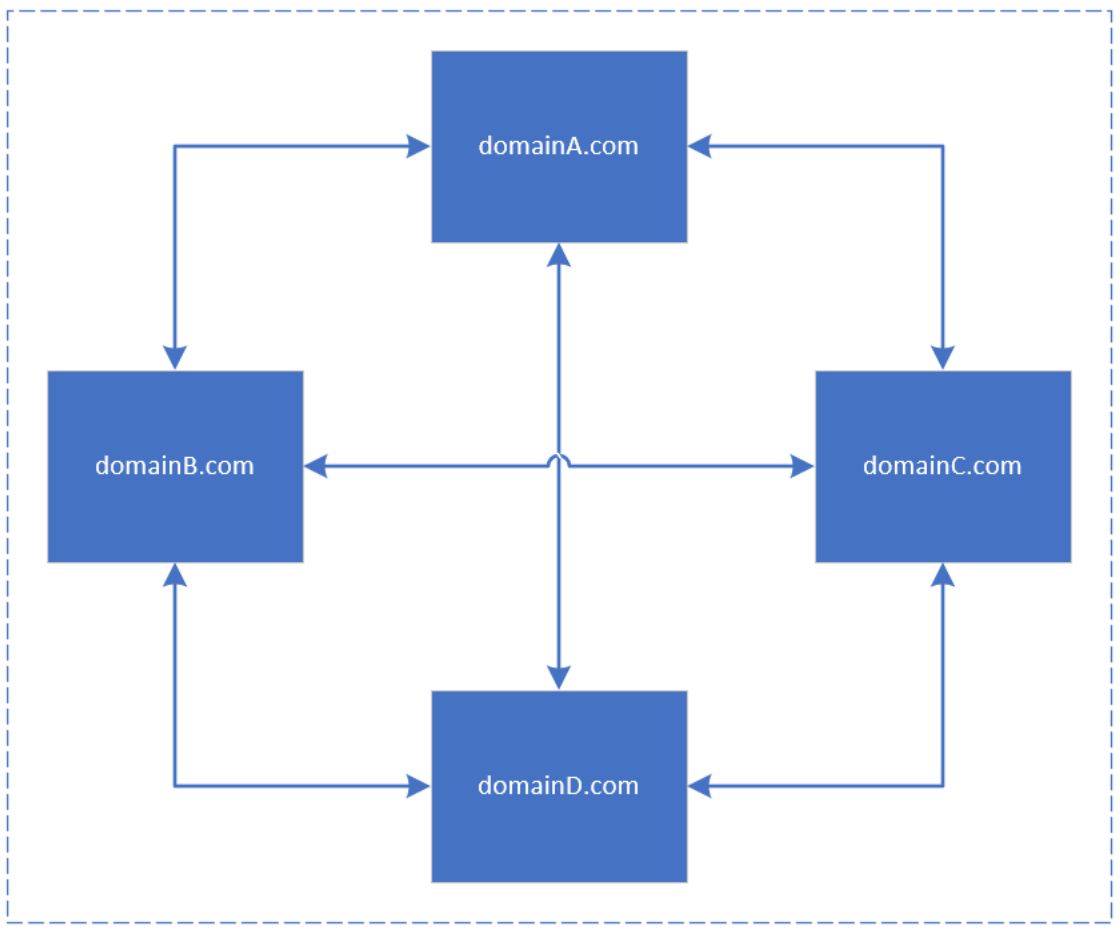

- Bing straft unorganische Seitenstrukturen ab. In dem aktuellsten Beitrag auf dem Bing Blog wird das neuste Update der Bing Webmaster Guidelines erklärt. Im Fokus steht hier die Abstrafung von sogenannten „inorganic site structures“. Es gibt viele Fälle, in denen eine Website auf mehrere Domains aufgeteilt wird und alle Domains offensichtlich zum Zweck eines Ranking-Boostings untereinander verlinken. Mehr Details zu dem neuen Update erfahrt Ihr hier.

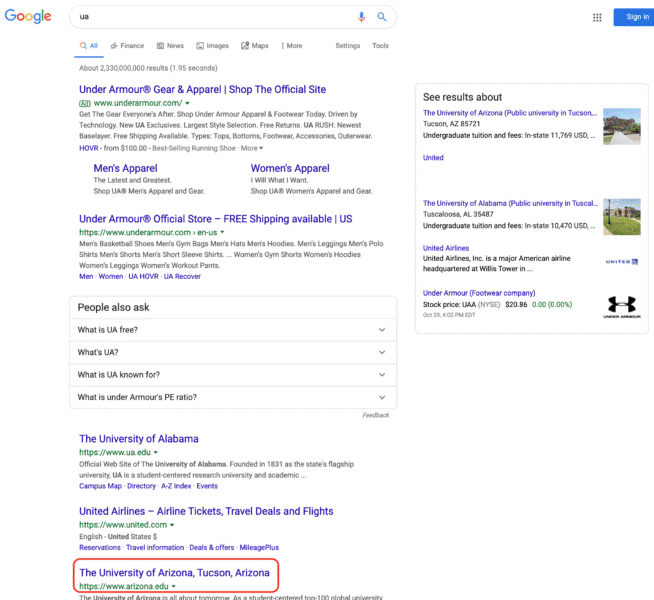

All diese Domains sind effektiv die gleiche Website ©BingBlogs - University of Arizona möchte seine Namensabkürzung wegen SEO ändern. Bisher war die University of Arizona unter anderem auch bekannt als „UA“, doch jetzt möchte die Universität diese Abkürzung umbenennen in „UArizona“. Grund dafür ist tatsächlich die Suchmaschinenoptimierung. Die Einfachheit des Keywords „UA“ bringt natürlich auch mehr Wettbewerber mit sich. So ranken zum Beispiel auch große Marken wie „Under Armour“ oder „United Airlines“ weit oben in den Suchergebnissen. Ein kurioser Fall, wie wir finden, und ein weiteres Beispiel, wie viel Einfluss SEO haben kann. Mehr über dieses Thema könnt Ihr bei searchengineland.com nachlesen.

University of Arizona rankt nur auf Platz 5 für das Kennwort UA ©SearchEngineLand

Unsere Tipps der Woche

- Googles Neu-Seiten vereinfachen das Erstellen von Dokumenten, Terminen und vielem mehr. Vor einigen Tagen wurde die „.new TLD“ von Google für die Öffentlichkeit freigegeben. Eine sehr interessante und vor allem nützliche Idee, die den Alltag sehr erleichtern könnte. So kann man zum Beispiel durch die Eingabe von „docs.new“ in die URL-Leiste des Browsers sofort ein neues Dokument in Google Docs erstellen oder durch „playlist.new“ eine neue Playlist in Spotify. Auf dem GoogleWatchBlog könnt Ihr die wichtigsten „.new-Domains“ noch einmal nachlesen. Wir sind gespannt, welche weiteren Funktionen uns noch erwarten.

- Google soll bald auch riechen können. Was vor ein paar Jahren noch als Scherz durch das Internet kursierte, soll in Zukunft Wirklichkeit werden. Die Google-Forscher arbeiten an einer künstlichen Nase, die auf Atom- und Molekül-Ebene Gerüche erfassen und auswerten kann. Die Idee ist noch in einer sehr experimentellen Phase, soll aber mit Hilfe von Googles künstlicher Intelligenz zuverlässige Ergebnisse liefern. Wenn Ihr im wahrsten Sinne etwas Zukunfts-Luft schnuppern möchtet, empfehlen wir Euch den GoogleWatchBlog-Artikel sowie das Whitepaper der Google-Forscher.

- „Kurzgesagt – In a Nutshell“ erster deutscher YouTube-Kanal mit über 10 Millionen Abonnenten. Allein in dem Jahr 2019 hat der YouTube-Channel rund 2 Millionen Abonnenten gewonnen und ist damit der größte Kanal Deutschlands. Die Videos von Kurzgesagt – In a Nutshell sind zwar auf Englisch, da aus den USA 40 % der Views kommen, allerdings gibt es für die deutschen Zuschauer eine Option für Untertitel. Die Inhalte sind nicht nur sehr unterhaltsam, sondern auch überaus lehrreich. Für das Wochenende definitiv ein Must-Watch-Tipp. Erfahrt mehr bei t3n.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Wir wünschen Euch ein schönes Wochenende!

Janek und die SEO-Trainees

2 Antworten

Ich habe die Konferenz auch verfolgt. Richtig interessant und man kann echt viel dort über SEO erfahren! Da ich nicht alles so richtig verstanden habe, wollte ich eine Zusammenfassung zum Nachlesen haben. Das hat mir sehr geholfen, es ganz zu verstehen, danke!

Lieber Tim,

vielen Dank für Dein Interesse an SEO-Trainee! Wir haben die Konferenz auch mit Spannung verfolgt. Schaue gerne regelmäßig bei uns vorbei. Der SEO-Wochenrückblick erscheint immer freitags.

Beste Grüße

Janek