Diesen Monat steht Google Discover im Rampenlicht: Mit dem ersten spezifischen Core Update (Februar 2026) und neuen technischen Insights wird der Feed endlich etwas berechenbarer. Außerdem klären wir, wie der neue Standard WebMCP die Ära der KI-Agenten einläutet und warum der Start von ChatGPT Ads für Werbetreibende vorerst ein Tracking-Blindflug bleibt. In den KI-News erfahrt ihr zudem, warum ein vergessenes „noarchive“-Tag eure Sichtbarkeit in Copilot killen kann und wie ihr mit Regex-Filtern echte KI-Prompts in eurer Search Console aufspürt.

Viel Spaß beim Lesen!

Google News

#01 Google Discover

#01 Google Discover Core Update im Februar 2026

Google hat im Februar erstmals ein Core Update speziell für Discover ausgerollt. Das Update startete am 5. Februar und wurde nach gut drei Wochen am 27. Februar abgeschlossen – eine Woche länger als ursprünglich erwartet. Es hat keinen Einfluss auf die regulären Suchergebnisse.

Drei zentrale Änderungen:

- Nutzer*innen sehen mehr lokal relevante Inhalte aus ihrem eigenen Land.

- Reißerische Inhalte und Clickbait werden reduziert.

- Ausführliche, originale Inhalte von thematisch spezialisierten Websites werden bevorzugt.

Dabei bewertet Google Expertise themenbezogen – eine lokale Nachrichtenseite mit eigenem Gartenbereich kann als Gartenexperte gelten, eine Filmseite mit einem einzelnen Gartenartikel nicht.

Wer als nicht-US-Publisher*in bisher Discover-Traffic aus den USA bezogen hat, muss mit Rückgängen rechnen. Erste NewzDash-Analysen bestätigen den sinkenden internationalen Anteil im US-Feed. Perspektivisch sollen diese Websites aber in ihren lokalen Märkten stärker profitieren.

#02 Google Discover von innen: Erstmals echte Einblicke in die Technik

Google Discover ist für viele Publisher*innen ein riesiger Traffic-Kanal – bei manchen macht er 80–90 % des gesamten Google-Traffics aus. Trotzdem wusste man bisher kaum, wie Discover intern funktioniert. Das ändert sich jetzt: Metehan Yesilyurt und Valentin Pletzer haben den Code der Google App zerlegt und erstmals konkrete technische Details offengelegt.

Was heißt das praktisch für euch? Google entscheidet vor allem über eine Klickwahrscheinlichkeits-Vorhersage (CTR-Prediction), welche Artikel im Feed erscheinen. Headline und Bild sind dabei entscheidend. Läuft es einmal schlecht, sinken auch die Prognosen für eure nächsten Artikel – ein Teufelskreis.

Die Empfehlung daher: Lieber weniger Artikel mit wirklich starken Headlines und Bildern veröffentlichen, statt auf Masse zu setzen.

Außerdem wichtig: Wenn Discover eure Seite verarbeitet, schaut es zuerst auf strukturierte Daten im JSON-LD-Format – und greift nur dann auf OG-Tags zurück, wenn dort nichts hinterlegt ist. Wer also nur OG-Tags pflegt, aber kein JSON-LD nutzt, überlässt Google die zweite Wahl statt der ersten. Und: Das Tag og:locale solltet ihr künftig unbedingt setzen, denn Discover nutzt es, um eure Inhalte der richtigen Sprache und Region zuzuordnen.

#02 WebMCP: Google definiert, wie KI-Agenten mit Websites interagieren sollen

Google hat mit WebMCP eine Early Preview für einen neuen Standard vorgestellt, der regelt, wie KI-Agenten mit Websites zusammenarbeiten. Die Idee: Statt, dass ein Agent sich mühsam durch eure Seite klickt, stellt ihr ihm strukturierte Werkzeuge bereit – und bestimmt damit selbst, wie und wo der Agent aktiv werden darf.

Warum ist das für euch relevant? Wir haben im Ausblick 2026 über „Agentic Commerce“ gesprochen – WebMCP ist genau die technische Grundlage dafür. Es gibt zwei Wege: eine einfache Variante über HTML-Formulare und eine komplexere über JavaScript für dynamische Aktionen. Konkret heißt das: Statt, dass ein KI-Agent eure Website per Screenshot und Pixel-Erkennung „abklickt“, definiert ihr über WebMCP technische Bedienstrukturen (z. B. „Flug suchen“ oder „In den Warenkorb legen“), die der Agent direkt zur fehlerfreien Bedienung nutzen kann. Damit können KI-Agenten künftig Flüge buchen, Supporttickets einreichen oder Produkte konfigurieren – direkt und zuverlässig, ohne Umwege über die klassische Oberfläche.

Für E-Commerce und Service-Websites wird das mittelfristig immer wichtiger: Wer seine Seite für KI-Agenten vorbereitet, wird in einer Welt, in der Nutzer*innen Aufgaben zunehmend an Agenten delegieren, einen klaren Vorteil haben. Wer sich frühzeitig mit WebMCP beschäftigen will, kann sich für Googles Early-Access-Programm registrieren.

KI-News

#01 ChatGPT schaltet Werbung – Tracking ausbaufähig

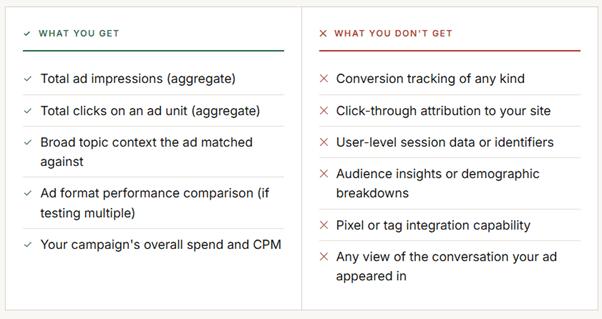

Seit dem 9. Februar 2026 können Unternehmen in ChatGPT Werbung schalten – zu einem CPM von 60 Dollar und einem Mindestbudget von 200.000 Dollar. Der Rollout läuft aktuell ausschließlich in den USA, für Deutschland gibt es bislang weder Zugang noch ein Buchungsmodell. Der Launch in Europa könnte jedoch nur eine Frage der Zeit sein – und es lohnt sich, das Thema schon jetzt zu verstehen.

Was ChatGPT-Ads grundlegend anders macht: Klassisches Conversion-Tracking gibt es nicht. Kein Pixel, keine Attribution, keine Zielgruppen-Insights – nur aggregierte Impressionen und Klicks. Das ist keine technische Lücke, sondern eine bewusste Designentscheidung: OpenAI hat Datenschutz und Nutzervertrauen über Advertiser-Interessen gestellt.

Was das praktisch bedeutet: Ein*e Nutzer*in sieht eure Anzeige, recherchiert weiter im Chat und kauft später über Google oder besucht eure Website direkt – ohne dass dieser Weg je in euren Daten auftaucht.

Was Werbetreibende in Vorbereitung auf den Rollout von GPT-Ads tun können:

- Ziel-URLs mit UTM-Parametern vorbereiten, um ChatGPT-Traffic in GA4 sauber von anderen Kanälen trennen zu können. Zusätzlich in GA4 eine eigene Kanalgruppierung für „ChatGPT Paid“ anlegen, damit der Traffic nicht unter „Direct“ oder „Other“ verschwindet.

- Baselines für Direkttraffic (GA4) und Branded-Search-Volumen (Google Search Console) jetzt schon wöchentlich dokumentieren – damit nach dem Launch verglichen werden kann, ob beides steigt. Das sind die wichtigsten indirekten Signale dafür, dass eine Kampagne gewirkt hat.

- ChatGPT Ads gedanklich als Branding-Kanal einplanen – vergleichbar mit TV oder Podcast-Werbung, nicht mit Google Search.

Abbildung 1: Erfolgt von GPT-Ads messen, Quelle: topgrowthmarketing.com

#02 Studie: Google-nicht-indexierte Seiten tauchen in Bing Copilot auf

Eine kleine, aber aufschlussreiche Studie von Indexing Insight (Februar 2026) zeigt: Seiten, die Google aus seinem Index entfernt hat, werden trotzdem in Bing AI Answers und Copilot zitiert.

Wie die Studie funktioniert hat: Die Forscher haben 30.000 Seiten aus drei verschiedenen Websites analysiert und dabei die neu erschienenen AI Performance Reports in Bing Webmaster Tools genutzt – ein Tool, das zeigt, welche eurer Seiten in Bing-KI-Antworten referenziert werden. Diese Daten wurden mit dem Google-Indexierungsstatus derselben Seiten abgeglichen. Das Ergebnis: Bei einer der untersuchten Websites waren 49 % der in Bing zitierten Seiten bei Google gar nicht (mehr) indexiert – fast immer wegen mangelnder Seitenqualität.

Warum das passiert: Google hat täglich 14 Milliarden Suchanfragen und nutzt diese Nutzersignale, um minderwertige Seiten aus seinem Index zu filtern. Bing fehlt dieser riesige Datenfeedback-Loop schlicht – und übernimmt deshalb auch Inhalte, die Google bereits aussortiert hat.

Was das für euch bedeutet: Content-Audits dürfen sich nicht länger nur auf Google-Daten stützen. Wer Seiten löscht oder auf noindex setzt, sollte vorher prüfen, ob sie möglicherweise noch aktiv in Bing-KI-Antworten genutzt werden – sonst entfernt ihr versehentlich relevante KI-Sichtbarkeit.

#03 Vorsicht: Das vergessene noarchive-Tag blockiert euch bei Copilot

Kennt ihr noch das <meta name=“robots“ content=“noarchive“>-Tag? Das war früher dafür da, Google anzuweisen, keine gecachte Version eurer Seite in den Suchergebnissen anzuzeigen. Da Google dieses Cache-Feature längst abgeschafft hat, schien das Tag harmlos – und wurde von vielen einfach vergessen oder nie ausgebaut.

Bing hat dem Tag jetzt still und leise eine neue Bedeutung gegeben: Wer noarchive im Code hat, dessen Seite wird bei Copilot nicht mehr angezeigt oder referenziert – und der Inhalt wird nicht für Microsofts KI-Modelle genutzt.

Das klingt erstmal unspektakulär, ist aber aus zwei Gründen heikel: Erstens könnten Website-Betreiber*innen vergessen haben, dass sie das Tag damals eingebaut haben. Zweitens hatten viele Publisher-CMS das Tag früher standardmäßig gesetzt – es könnte also noch auf zahlreichen Seiten schlummern, ohne dass es jemand bemerkt.

Handlungsempfehlung: Macht einen kurzen Check eures Quellcodes – zum Beispiel per Screaming Frog oder einer einfachen Suche im CMS. Gerade wenn ihr auf KI-Sichtbarkeit setzt, solltet ihr sicherstellen, dass ihr euch nicht selbst aus Copilot aussperrt.

#04 Ganze Websites mit einem einzigen API-Call crawlen

Cloudflare hat eine neue /crawl-API-Schnittstelle vorgestellt. Für SEOs und Content-Verantwortliche lohnt es sich, einen Blick darauf zu werfen. Der Dienst ermöglicht es, mit einem einzigen API-Aufruf eine komplette Website zu crawlen – inklusive Rendering im Headless-Browser. Die Ergebnisse werden in verschiedenen Formaten zurückgeliefert: HTML, Markdown oder strukturiertes JSON.

Was das praktisch bringt: Ihr gebt eine Start-URL ein und bekommt automatisch alle entdeckten Seiten verarbeitet zurück – ideal für Content-Monitoring, RAG-Pipelines oder die systematische Analyse von Wettbewerber-Seiten. Dabei lassen sich Crawl-Tiefe, Seitenlimits und URL-Muster gezielt steuern. Besonders nützlich: Mit der inkrementellen Crawl-Funktion werden nur Seiten neu abgerufen, die sich seit dem letzten Durchlauf verändert haben.

Wichtig für Website-Betreiber*innen: Der Crawler respektiert standardmäßig robots.txt und Cloudflares AI Crawl Control – er identifiziert sich also als Bot und hält sich an eure Vorgaben. Das ist ein bewusster Unterschied zu vielen KI-Crawlern, die Website-Regeln oft ignorieren.

Die Funktion ist als Open Beta verfügbar, auch im kostenlosen Cloudflare-Plan. Alle Details und Parameter findet ihr in der offiziellen Crawl-Endpoint-Dokumentation.

Tipps des Monats

#01 Prompt-Monitoring mit „Negativ-Prompts“

Während viele noch klassisch nach „besten Laufschuhen“ suchen, stellen andere KI-Tools inzwischen gezielte Negativfragen, etwa „Welche Laufschuhe sind schlecht für Plattfüße?“ oder „Welchen Öl-Lieferdienst sollte ich meiden?“ Doch welche Antworten liefern KI-Modelle bei solchen Anfragen eigentlich?

In einem Test wurden Google AI Mode, Copilot und ChatGPT mit solchen Negativ-Prompts konfrontiert.

Das Fazit:

- AI Mode war am stärksten: konkrete Namen, Quellen aus Reddit und Google Reviews, transparente Belege.

- ChatGPT landete in der Mitte: beschreibend und detailliert, aber oft ohne Quellenangaben und teils widersprüchlich (ein Anbieter wurde gleichzeitig als unseriös und als Empfehlung gelistet).

- Copilot blieb am vorsichtigsten: keine konkreten Namen, nur allgemeine Warnzeichen, hilfreich, aber wenig konkret.

Die Ergebnisse zeigen, dass KI-Modelle durchaus konkrete Namen und Quellen nennen. Dies zeigt, dass es sinnvoll sein kann, Negativ-Prompts auch ins eigene Prompt-Monitoring aufzunehmen. Taucht die eigene Marke in solchen Antworten auf, lohnt sich eine gezielte Quellenrecherche: Woher stammt diese Einschätzung, und was lässt sich dagegen tun? So werden Negativ-Prompts zu einem wertvollen Werkzeug, um die Markenwahrnehmung in KI-Modellen besser zu verstehen und Optimierungen gezielt abzuleiten. Seid aber darauf bedacht, solche Negativ-Prompts aus dem Monitoring eurer Visibility im Allgemeinen rauszuhalten.

#02 Claude für SEO-Workflows

Wer im technischen SEO arbeitet, kennt einige zeitintensive Routineaufgaben. Von der manuellen Prüfung von Crawl-Exporten bis hin zum Schreiben von Kunden-Briefings. Es wurde getestet, wie Claude diese Workflows konkret verändern kann. Das Ergebnis ist ein strukturiertes Trainingsprogramm speziell für SEO-Agenturen.

Das Programm gliedert sich in zwei parallele Lernpfade:

- Efficiency Track – für das gesamte Team: Prompting-Grundlagen, fertige Prompt-Bibliotheken, Tiefenanalysen und Team-Standardisierung

- Build Track – für Analysten und technisch Interessierte: Claude Code, eigene SEO-Tools entwickeln, API-Anbindungen, Logfile-Analyse

Am Ende stehen sieben einsatzbereite Skripte, die manuelle Prozesse ersetzen, etwa für HTTP-Status-Checks, PageSpeed-Batch-Prüfungen oder einen KI-gestützten Content-Brief-Generator. Die geschätzten Zeitersparnisse sind dabei beachtlich: Was früher einen halben Tag dauerte, soll mit Claude in 10–20 Minuten erledigt sein.

Der zentrale Gedanke dahinter: KI ersetzt kein SEO-Fachwissen, aber sie beseitigt die Hürde zwischen Wissen und Umsetzung. Wer das Handwerk beherrscht, kann mit Claude deutlich schneller und effizienter arbeiten.

#03 „Prompts“ in der GSC finden

Welche Prompts Nutzer*innen in KI-Systemen stellen, ist bislang eine große Blackbox. Doch ein Ansatz aus der Search Console liefert zumindest interessante Hinweise.

Die Idee: Suchanfragen mit zehn oder mehr Wörtern lesen sich oft wie echte KI-Prompts. Per Regex-Filter in der Search Console lassen sich genau diese langen Anfragen herausfiltern:

- Search Console → Performance → Suchanfragen → Filter → Custom Regex

- Regex: ^(?:\S+\s+){9,}\S+$

- Das Ergebnis: Anfragen, die sich klar wie Konversationssuchen lesen

Diese Daten lassen sich anschließend exportieren und mit Claude oder einem anderen KI-Tool eurer Wahl analysieren. Dabei können Muster und Themen identifiziert werden, etwa welche Produkteigenschaften Nutzer*innen interessieren, wie Fragen typischerweise formuliert werden oder welche Wettbewerberinnen als Benchmark genutzt werden.

Zusätzlich kann das für euer Prompt-Monitoring ein interessanter Ansatz sein, um das eigene Prompt-Set mit neuen Ideen anzureichern.