Strucr.com ist ein Crawler, der es ermöglicht, große Websites zu spidern und dabei Daten über die Struktur eines Web-Auftritts zu sammeln. Im Gegensatz zu anderen Crawlern wie dem Screaming Frog oder Xenu’s Link Sleuth liefert Scrucr umfangreichere Daten und Reports. Gerade gab’s einen Relaunch – klar, dass wir uns das SEO Tool mal genauer ansehen wollten.

Wir stellen vor: die Kerneigenschaften von Strucr.com

Der Strucr-Dienst unterscheidet sich in einigen Punkten von den herkömmlichen Crawlern, wie dem Screaming Frog oder Xenu’s Link Sleuth. Hier haben wir ein paar wichtige Eigenschaften für euch zusammengestellt:

- Der Strucr-Crawler ist keine downloadbare Software, sondern ein Service der Strucr GmbH, der über srtucr.com zur Verfügung gestellt wird. So können auch mehrere Personen gleichzeitig auf die Daten der Crawls zugreifen.

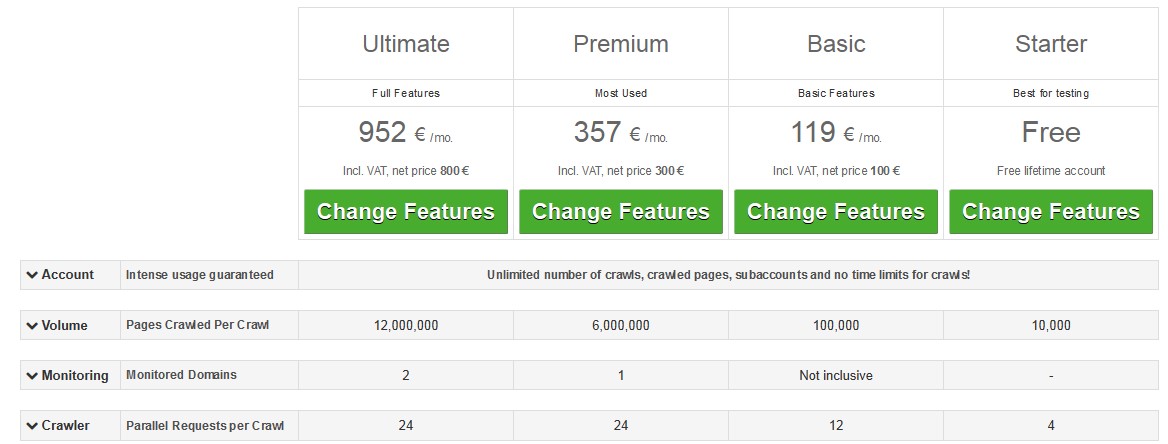

- Je nach Bedarf gibt es vier unterschiedliche Service-Pakete, die von einer kostenlosen Version (Starter-Paket) bis zur Ultimate-Version mit vollem Leistungsumfang für 952 Euro pro Monat reichen.

- Der Strucr-Crawler ist besonders stark und crawlt daher auch große Seiten ohne Probleme. Er arbeitet von einem eigenen Server aus – dadurch wird seine Leistungsfähigkeit garantiert. Das Crawl-Limit ist durch die unterschiedlichen Pakete festgelegt. Das Ultimate-Paket erlaubt beispielsweise das Crawlen von 12 Millionen Seiten. Unglaublich! Mit diesem Angebot spricht Strucr gezielt Großkunden an.

- Der Strucr-Service beinhaltet zusätzlich zur Crawling-Funktion eine Monitoring-Funktion, bei der die Seite regelmäßig gecrawlt wird.

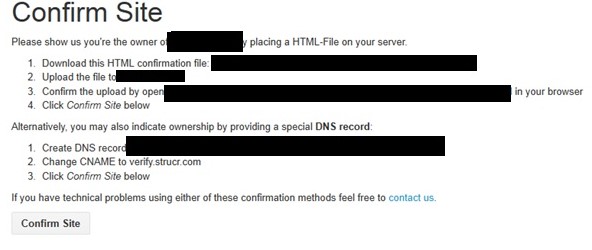

- Wichtig: Der Crawler kann nur für die eigene oder eine Kunden-Website genutzt werden, denn zuerst ist eine Verifizierung der Crawl-Berechtigung notwendig. So beugt Strucr vor, dass fremde Seiten gecrawlt werden, die Umsatzeinbußen durch den Crawl-Vorgang davontragen könnten.

- In den Crawling-Reports erhält man nicht nur die Rohdaten, sondern Diagramme und grafische Auswertungen.

- Alle Daten sind auch via API, also über eine Programmierschnittstelle, abrufbar und können somit von eigenen Programmen weiterverarbeitet werden. Fast alle Daten könnt ihr zudem in Excel exportieren.

- Die Geschwindigkeit des Crawl-Vorgangs, die maximale Anzahl an Seiten und die maximale Crawl-Tiefe können individuell bestimmt werden.

- In den Einstellungen kann man festlegen, ob sich der Crawler an die robots.txt-Datei halten soll oder nicht.

Mehr Details über die Funktionen lest ihr weiter unten unter „Crawl-Daten“ nach. Für unseren Review durften wir die Ultimate Version testen.

Erster Eindruck und Usability

Die Benutzeroberfläche ist komplett in Englisch. Macht nichts – technische Begriffe sind schließlich alle auf Englisch. Die Anmeldung und das Einreichen einer Website sind dafür aber echt einfach. Bevor man jedoch mit einem Crawl loslegen kann, muss jede angelegte Website verifiziert werden. So soll Missbrauch vermieden werden. Das ist schnell durch den Upload einer HTML-Datei auf die zu crawlende Website gemacht. Alternativ kann man dem DNS (Domain Name System) einen CNAME-Datensatz (Alias) hinzufügen.

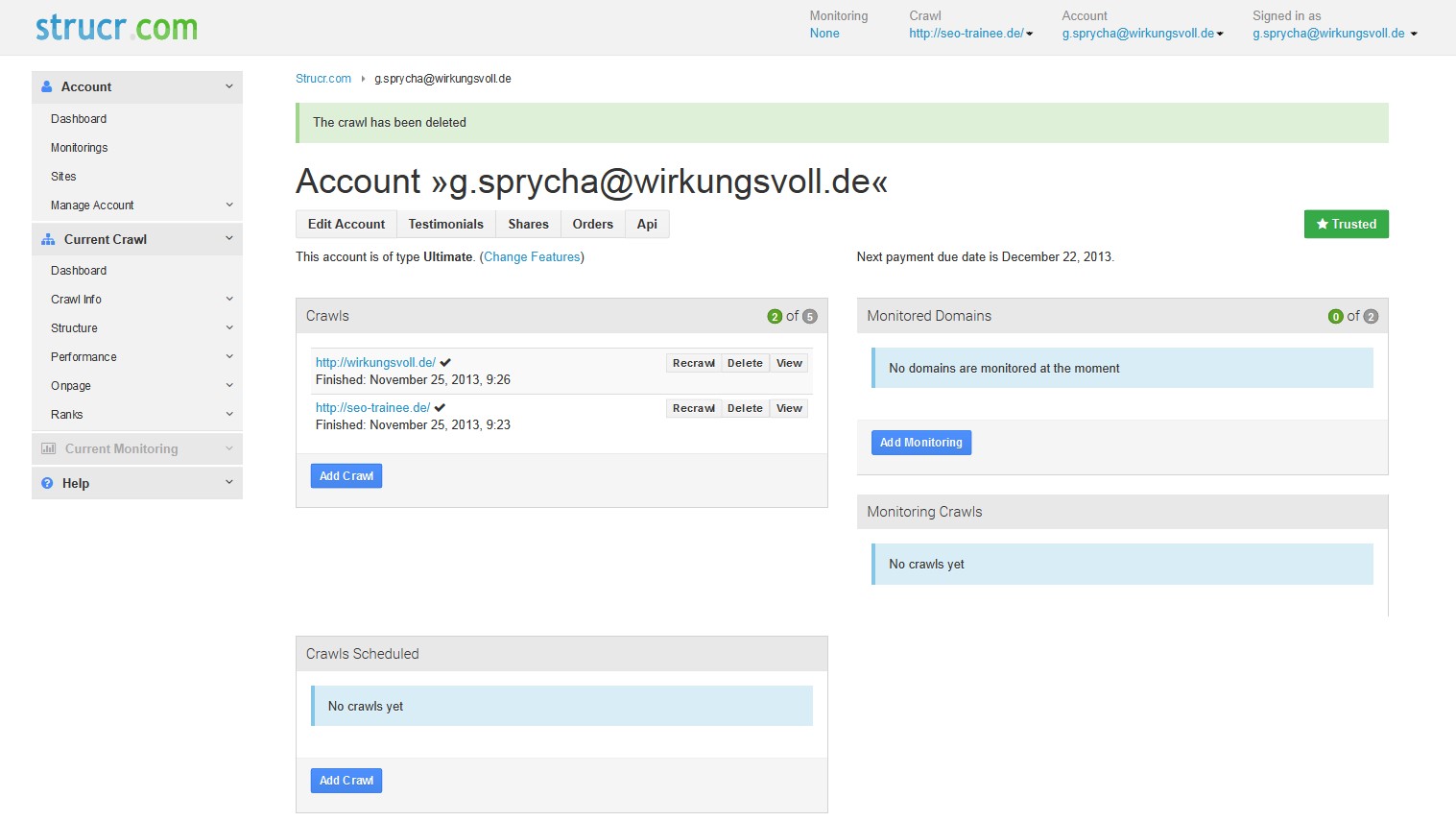

Die ersten Schritte gingen also wirklich easy. Auch die Benutzeroberfläche ist sehr übersichtlich gestaltet. Auf dem Dashboard sieht man nur die nötigsten Daten, nämlich welche Seiten man angelegt und welche man gecrawlt hat. Unter „Add Site“ kann man dem Account eine neue Domain hinzufügen. Direkt über das Dashboard kann man festlegen, ob man diese Seite crawlen oder monitoren möchte.

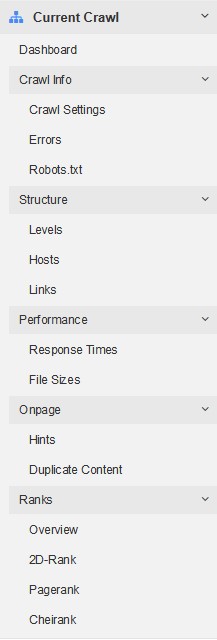

Das Menü auf der linken Seite ist über ein Dropdown-Menü auf- und zuklappbar und hilft so bei der schnellen Orientierung. Über den Menüpunkt „Current Crawl“ gelangt man zu den Reports über den ausgewählten Crawl. Entweder kann man sich hier im Menü entlanghangeln und die einzelnen Reports anschauen oder man gibt in „Find Page“ eine URL ein und erhält für die URL alle Daten im Überblick. Praktisch! Die Daten in den Reports sind top aufbereitet! Hier gibt es nichts zu meckern! Ein kleines Fragezeichen erklärt beim Mouse-Over die einzelnen Datenbereiche, doch meistens reicht die Überschrift bereits als Erklärung aus, wenn man in der Suchmaschinenoptimierung unterwegs ist. Aber welche Daten liefert Strucr genau? Das schauen wir uns mal im Menü an.

Crawl-Daten

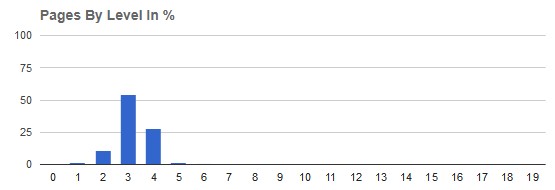

Levels

Strucr liefert Daten über die Hierarchieebene des Contents und der einzelnen URLs. Im Sinne der Crawlability empfiehlt sich eine flache Seitenstruktur. Wer seine Inhalte zu tief in einer Seite „versteckt“, braucht sich nicht wundern, wenn nicht alle Inhalte indexiert werden. Daher bietet diese Funktion von Strucr einen guten Überblick über die Seitenarchitektur. Der Strucr-Crawler geht dabei sehr tief in die Ebenen hinein.

Hosts

Alle Domains, auf die der Strucr-Crawler über einen Link gestoßen ist, werden hier tabellarisch aufgeführt. Man sieht auf einen Blick, wieviele Links auf externe Seiten zielen.

Links

Unter diesem Menüpunkt seht ihr Daten rund um das Thema Links. So seht ihr hier die URLs mit den meisten ausgehenden Links, die Seiten mit den meisten eingehenden Links und externe Seiten, auf die besonders häufig von eurer Website verlinkt wird. Strucr weist darauf hin, dass Seiten nur dann häufig verlinkt werden sollen, wenn sie besonders wichtig sind. Hier kann man also nochmals hinterfragen, ob durch diese interne Verlinkung die Hierarchie der eigenen Seite unterstützt wird.

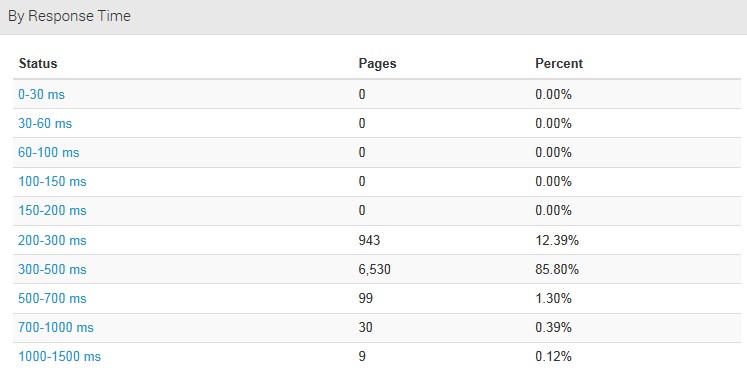

Response Times

Wie lange braucht der Server, um eine Antwort beim Aufrufen der einzelnen URLs zu senden? Das zeigt dieses Feature. Da die Response-Zeiten direkte Auswirkungen auf die Ladegeschwindigkeit einer Seite haben, sind lange Response Times zu vermeiden. Die Ladegeschwindigkeit ist ein direkter Ranking-Faktor.

File Sizes

Während des Crawlings werden die Dateigrößen der einzelnen Seiten ermittelt. Auch dies ist ein Faktor, der die Ladegeschwindigkeit mitbestimmt und daher lohnt sich ein Blick auf die Daten.

Hints

Wenn der Crawler auf der Seite auf etwas gestoßen ist, was nicht suchmaschinenfreundlich ist, findet ihr hier Informationen dazu. So zum Beispiel, wenn eine Seite intern nicht verlinkt ist, wenn keine H1-Überschrift vergeben wurde, wenn kein Alt-Attribut vergeben wurde oder wenn der Title zu lang ist. Strucr kennt bis jetzt 61 dieser Hinweise, die auf dieser Liste nachgelesen werden können und von Strucr erklärt werden. Beim Klick auf den jeweiligen Hinweis werden alle URLs angezeigt, auf denen der Fehler auftritt.

Duplicate Content

Dieses Feature gibt es erst seit dem Relaunch und ist echt spannend. Wieso? Doppelte Inhalte senden kein positives Signal an Google und sollten daher vermieden werden. Besonders häufig treten doppelte Inhalte in Online Shops auf. Um DC aufzudecken, crawlt man die Seite und schaut dann nach doppelten Titles und Meta-Descriptions. Bei großen Seiten (wie bei Online Shops) wird das schnell unübersichtlich. Mit Strucr könnt hier auf einen Blick sehen, wo der Crawler auf doppelte Meta-Descriptions oder Titles gestoßen ist.

PageRank

Strucr ermittelt eine Reihe von Werten, die in Tabellenform ausgegeben werden. So auch der PageRank, der anzeigt, wie gut eine Seite intern verlinkt ist. Demnach wird ermittelt, wie wichtig eine einzelne Seite innerhalb der gesamten Domain ist. Dafür setzt Strucr die gesamte Anzahl an Seiten der Domain in Relation zueinander, sodass die Summe aller PageRank-Werte = 1 ist. Damit ist der Strucr-PageRank nicht mit dem PageRank von Google gleichzusetzen. Der PageRank wird als eine Prozentzahl angegeben und ist ein nützlicher Wert, um die Authority einer Seite zu bewerten. Je höher der PageRank, desto mehr interner Link Juice fließt auf die Seite. Wofür kann man diese Daten nutzen? Die Seiten mit einem hohen internen PageRank sollten das Unternehmensziel voranbringen indem sie den Nutzer zu einer Conversion führen. Wenn die Conversion-trächtigen Seiten keinen hohen PageRank haben, müsst ihr sie gezielt durch eine interne Verlinkung stärken. Zudem lohnt es sich, die Seiten mit hohem PageRank hinsichtlich ihrer Usability zu optimieren, um die Konversionsrate zu erhöhen und die Absprungrate möglichst gering zu halten.

CheiRank

Der CheiRank ist das Gegenstück zum PageRank, denn es werden die ausgehenden Links der einzelnen Seiten erfasst. Seiten mit einem hohen CheiRank geben viel Link Juice an andere Seiten weiter. Hier liefert Strucr zwei Tabellen: Einmal werden alle URLs mit hohem CheiRank angezeigt, die zweite Tabelle zeigt Seiten mit hohem CheiRank und geringem PageRank. Für den CheiRank wird der Wert ebenfalls als Prozentanzahl angegeben und die Summe aller CheiRanks der gesamten Domain ist 1. Ein hoher CheiRank ist ein Indikator für eine wichtige Hub Page. Eine Hub Page nimmt eine navigierende Funktion innerhalb der Domain ein und führt den User über Links zu wichtigen Seiten. Auch hier gibt’s einen Tipp von Strucr: Für Hub Pages sollten Backlinks von externen Autoritätsseiten generiert werden und auch die interne Verlinkung sollte stimmen. Haben einige der Hub Pages wenige eingehende Links, müssen sie durch interne Links von Seiten mit hohem PageRank gestärkt werden.

2D-Rank

Strucr zeigt in einer Tabelle die 2D-Ranks der einzelnen URLs an. Der 2D-Rank ermittelt die wichtigsten Seiten einer Domain, indem er PageRank und CheiRank miteinander verknüpft. Man kann sich einen Graphen vorstellen mit den beiden Achsen PageRank und CheiRank, auf denen die Werte eingetragen werden. Den einzelnen URLs wird dann ein Rank zugeordnet – die Seite mit dem 2D-Rank von 1 sollte die wichtigste Seite sein. Meist ist das die Startseite einer Website. Wenn man nicht die wichtigsten Seiten seiner Website auf den ersten Plätzen wiederfindet, sollte man die interne Verlinkung weitergehend analysieren und dementsprechend verändern.

Fazit

Strucr ist für Agenturen und große E-Commerce-Unternehmen ein interessantes Tool. Die Daten, die hier zur Verfügung gestellt werden, sind wirklich umfangreich. Wer den Strucr-Service testen möchte, dem lege ich die kostenlose Starter-Version ans Herz. Obwohl es eine Starter-Version gibt, bleibt mein Eindruck, dass Strucr weniger für den kleinen Webmaster geeignet ist. Hier braucht man schon gute SEO-Kenntnisse, um die Datenflut auch richtig zu interpretieren. Die Erklärungen der Daten sind für einen Anfänger nicht umfassend genug. Für mich ist der Relaunch aber vollends geglückt. Die Benutzeroberfläche ist intuitiv zu navigieren und es wurden spannende neue Funktionen hinzugefügt. Besonders das Duplicate Content Feature hat es mir angetan und ich vermute, dass große Seiten hier den meisten Benefit ziehen können.

Noch eine schöne Restwoche wünschen

Gesa und die SEO Trainees

12 Antworten

Hallo,

interessant, das mit dem CheiRank. Die Suite von Searchmetrics berechnet diese Kennzahl auch. Bei Sistrix und Moz, den anderen Tookls, die ich noch regelmäßig verwende noch nicht.

Grüße,

Hallo,

interessant, das mit dem CheiRank. Die Suite von Searchmetrics berechnet diese Kennzahl auch. Bei Sistrix und Moz, den anderen Tookls, die ich noch regelmäßig verwende noch nicht.

Grüße,

Hi guter Artikel,

Ich werde in Zukunft öfter vorbeikommen.

Gestern erst strucr installiert und vor einigen Fragezeichen gestanden. Heute die tolle Erklärung dazu auf euer Seite gefunden.

Jetzt ist mir einiges klarer. Vielen Dank

Nochmals Hallo Gesa,

hab ja gerade schon beim aktuellen Post einen Kommentar hinterlassen, aber da ich nicht mehr von dieser Seite loskomme ;), gleich noch einer.

Arbeiten in unserer Agentur mit Sreaming Frog, aber werd diese Alternative mal ansprechen, da mir das Tool um einiges hilfreicher erscheint.

In diesem Sinne…nochmals Danke und Grüße,

Irina

Danke für den Beitrag!

Ich habe schon länger mal nach einem Tool gesucht, bei der ich meine Seitenstruktur mal untersuchen lassen kann. In der Hinsicht hat es mir in der Tat weitergeholfen.

Leider scheint die Funktion zum aufspüren von Duplicate Content nicht die Nutzer der Free-Version zu sein … schade.

Aber auch so hat es ein paar nützliche Einblicke gegeben.

Gruß,

Jens

Das ist wirklich eine super Software und der Preis ist auch ok.

LG Mike

Hi Mike,

danke für deine Meinung. Mir hat es auf jeden Fall echt Spaß gemacht, Strucr zu testen!

Ein krasses Tool. Leider ist es wohl großen Agenturen oder Unternehmen vorbehalten, wie Du ja schon gesagt hast. Trotzdem werde ich mich mal für die Freversion registrieren. Ich bin gespannt.

Hallo,

sehr guter Beitrag! Ich bin durch zufall darauf gestoßen und ich muss sagen strucr.com ist wirklich ein geniales Tool, das mir sehr viel Zeit erspart.

Unsere Webseite ist schon sehr groß (druckertinte.de) und damit bekommen wir den perfekten Überblick!

Gruß

Michael

Hallo Michael,

danke für dein Lob! 🙂 Dann euch weiterhin viel Erfolg!

Liebe Grüße

Gesa